近年来,人工智能的迅猛发展不断改变着人们的生活方式,尤其是在沟通和信息获取的领域。OpenAI 的 ChatGPT 系列产品因其出色的语言理解和生成能力受到了广泛欢迎。就在今年 8 月,当 OpenAI 发布了他们的新一代模型 GPT-5 时,却引发了用户们的强烈不满,特别是该公司决定移除 ChatGPT 中的模型选择器。这一变化令大量用户感到困惑和失望,引发了关于模型透明度与用户选择权的热烈讨论。

这次事件的导火索源于用户们对 GPT-5 的不同看法。尽管许多用户对 GPT-5 出色的功能赞不绝口,但同时也有不少用户对此表示不满,尤其是对于 OpenAI 决定移除 ChatGPT 模型选择器这一举措感到愤怒。特别是情感表达能力更强的 GPT-4o 模型被移除后,用户们纷纷通过社交媒体发声,发起请愿活动,诉说自己的失落与不满。

在 Reddit 上,一名用户的发言引发了广泛关注。他表达了自己因为 OpenAI 的决定而取消了订阅,并表示,“OpenAI 失去了我所有的尊重。”这位用户指出,不同的模型在特定场景下有着独特的优势,GPT-4o 在创意发散方面表现突出,而 o3 则专注于纯逻辑问题,o3-Pro 用于深度研究,4.5 则是写作的专业工具。他质疑 OpenAI 如何能够在没有任何事先通知的情况下,连夜删除多个功能不同的模型,剥夺了用户的选择权。

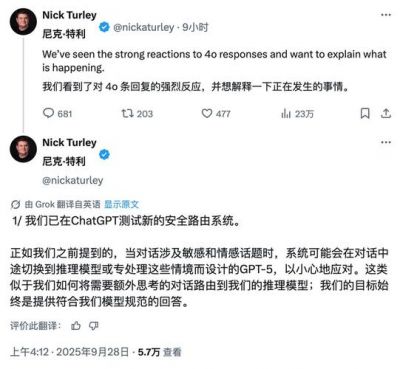

为平息用户的不满,OpenAI 一度做出妥协,允许 ChatGPT Plus 订阅用户使用熟悉的 GPT-4o 模型。事情并没有就此平息。社交媒体用户 Lex 在其账号上透露,用户在与 GPT-4o 进行情感交流时,实际上会被路由到一个名为“gpt-5-chat-safety”的模型。更令人失望的是,这一模型在执行任务时表现相当平庸,甚至比之前的 GPT-5 更差。该模型似乎专门用于处理涉及情绪的内容,但在大多数情况下,用户并未得到任何关于模型转换的明确通知。

Lex 在测试中发现,不论用户发送的内容内容如何,只要包含一点情感,系统会自动将对话转向“gpt-5-chat-safety”模型,而这并不适用于每种情景下的对话。他批评 OpenAI 的做法显示了对用户的误导性,以及对用户情感表达的忽视。他认为,这种处理方式在许多情况下不符合用户的实际需求,而将可能涉及心理健康问题的对话内容直接转到安全模型更是对功能的滥用。

在这一事件中,许多人开始反思什么是技术进步的合理边界,OpenAI 的做法是否在无形中侵犯了用户的知情权和选择权。Lex 分享的内容不仅引发了广泛关注,更引起了人们对 OpenAI 在 AI 模型透明度方面的质疑。他的推文下,很多用户也抱怨称,不仅是 GPT-4o,连 GPT-4.5 也存在相同的问题,表明这已经成为 ChatGPT 中处理情绪对话的默认模型。

此事件再一次强调了在追求技术进步的同时,如何保持用户信任的重要性。对于一家以源于深度学习技术而崛起的公司而言,建立良好的用户关系至关重要。若用户无法清楚了解自己使用的AI模型及其背后的工作机制,这是对用户信任的重大打击。

在此背景下,OpenAI 的管理层需要认真审视这次事件所反映出的问题,主动与用户沟通并提供清晰的信息。如果 OpenAI 继续保持不透明的做法,用户对其系统的信任势必将雪上加霜。在未来的发展过程中,OpenAI 亟需找到在技术迭代与用户尊重之间的平衡点,强化对用户的透明度与信息披露,以维护用户的权益和信任。

用户对 OpenAI 移除 ChatGPT 模型选择器的愤怒并非空穴来风。这件事情折射出的是当今快速发展的技术界,与用户之间存在的一种微妙的信任关系。在不断追求创新的同时,如何让用户感受到他们的需求被重视,将是 OpenAI 面临的一项重要挑战。