2023年,欧盟推出了一项革命性的立法——《人工智能法案》,旨在应对人工智能技术快速发展的挑战。根据Bird&Bird的分析报告,此法案是一部覆盖全面的法律文件,预计将在2025年正式生效,包含多项关键内容,为人工智能的监管提供了清晰的框架。

一、法案概述与关键概念

《欧盟人工智能法案》的出台,标志着欧盟在人工智能领域监管上迈出了重要一步。这部法案提出了基于风险的分类监管模式,对人工智能系统进行全面评估,并将其划分为四类:不可接受风险、高风险、有限风险和风险极小或无风险。此举旨在确保人工智能技术在开发与使用过程中,符合伦理和社会责任标准。

该法案适用于各类经济运营者,包括人工智能开发者、提供者及使用者等,涵盖广泛。法规的适用范围不仅限于欧盟境内,还可能适用于在欧盟市场上运营的非欧盟企业,这样的全球性视野为合规提供了更高的标准。

二、监管具体内容

1. 禁止的人工智能实践

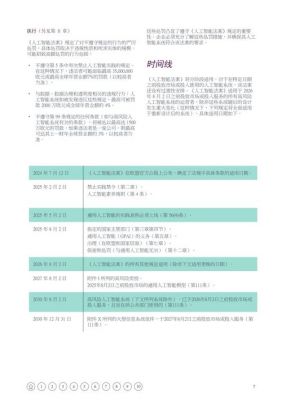

《人工智能法案》中明确列出了八种被禁止的人工智能实践。这些做法涉嫌侵害人权和社会伦理,如利用潜意识操控手段、造成社会评分系统的不公正及利用弱势群体等。从2025年2月2日开始,任何违反上述禁令的实体和个人都可能面临巨额罚款,这一措施表明了欧盟对伦理底线的坚定立场。

2. 高风险人工智能系统

对于高风险人工智能系统,法规对其提供者、部署者等主体设定了严格的合规义务。例如,提供者需要进行符合性评估,确保其产品安全性、可靠性,且必须建设质量管理体系。特别的是,某些与公共安全、健康、关键基础设施等相关的人工智能系统,将受到更为严格的监管。这反映出法律对于保护公众利益与安全的高度关注。

3. 通用人工智能模型

针对通用人工智能模型,法案要求其遵循特定规则,确保其开发和使用过程中的透明性和责任性。模型的提供者需承担更多透明度义务,特别是在涉及系统性风险的情况下,必须进行充分的风险评估与事件管理。

4. 透明度义务

根据风险的不同等级,人工智能系统需遵循不同的透明度要求。例如,任何与用户直接交互或生成合成内容的系统都必须披露其使用目的、技术运作的基本原理等信息,确保用户在使用过程中知情并能作出明智选择。

三、监管机制与措施

《人工智能法案》还设立了人工智能监管沙盒,旨在鼓励创新并促进合规。这一机制为新兴科技企业在实践中进行试验与完善提供了安全的环境,帮助确保其产品最终能符合法规要求。

法案还规定了详尽的执法与治理架构,设立了明确的市场监管机构与基本权利保障机构,负责对市场上的人工智能系统进行监测、报告和违规行为处置。这为法律的实施提供了强有力的保障。

四、未来走向

《人工智能法案》计划于2024年8月1日正式生效,多数条款将于2026年8月2日起实施。为了保障法规的有效实施,欧盟委员会将负责制定一系列的授予法案、执行法案、指引及标准,确保人工智能技术发展在法规框架内进行。这不仅为欧盟国家的科技企业指明了发展方向,同时对全球范围内的人工智能监管也具有重要的借鉴意义。

欧盟人工智能法案的推出,构建了一套系统的、全面的人工智能监管体系。从概念定义、适用范围到各类活动的规范,直至建立高效的监管和执行机制,为促进可持续的人工智能发展提供了坚实基础。随着这一法规的实施,欧盟将在全球人工智能治理中发挥越来越重要的作用,也将为其他国家和地区的人工智能立法提供有益的参考和借鉴。